BeingBeyond最新成果:首个利用人类操作轨迹训练的VLA-Being-H0

让机器人在真实世界中理解人类意图并完成相应动作,一直是具身智能领域的核心挑战。然而,视觉-语言-动作模型的发展正面临一个亟待解决的难题:真实机器人操作数据严重不足。

针对这个问题,目前机器人行业已投入巨资建立数据采集平台,但仍杯水车薪,现有数据量距离模型规模定律所需的上亿级样本之间的巨大差距,成为制约技术突破的关键因素。

在此背景下,BeingBeyond研究团队提出了一项创新解决方案:从海量的人类操作视频中提取手部运动轨迹,构建了规模达到亿级的高质量训练数据集。

更重要的是,团队提出了“物理指令微调”这一全新方法框架,能够将人类手部运动精准映射到机器人的动作空间,从而打通从视觉理解到动作生成的闭环。

Being-H0论文封面

基于这一突破,团队成功训练出首个利用人类手部视频数据的大规模预训练VLA模型——Being-H0,并在真实机器人平台上完成了系统验证。研究揭示了几个关键发现:人类双手可被视为各类末端执行器的通用模板;通过大规模人手操作视频进行预训练,能够有效解决数据稀缺问题;该方法可显著提升机器人任务的成功率,并大幅降低对真实机器人数据的依赖。

Being-H0:首个利用人类操作轨迹训练的大规模VLA模型

Being-H0建立在一个重要假设之上:人类手部运动是最具通用性的操作范式,现有各类机器人末端执行器均可视为其子集。无论是复杂的五指灵巧手,还是简单的二指夹爪,都能从人类手部运动知识中受益。通过学习人类操作轨迹进行预训练,可以构建具备广泛适应性的基座模型。

此外,这类视频数据在短视频时代极易获取,且天然避免了仿真数据与真实场景之间的差异。

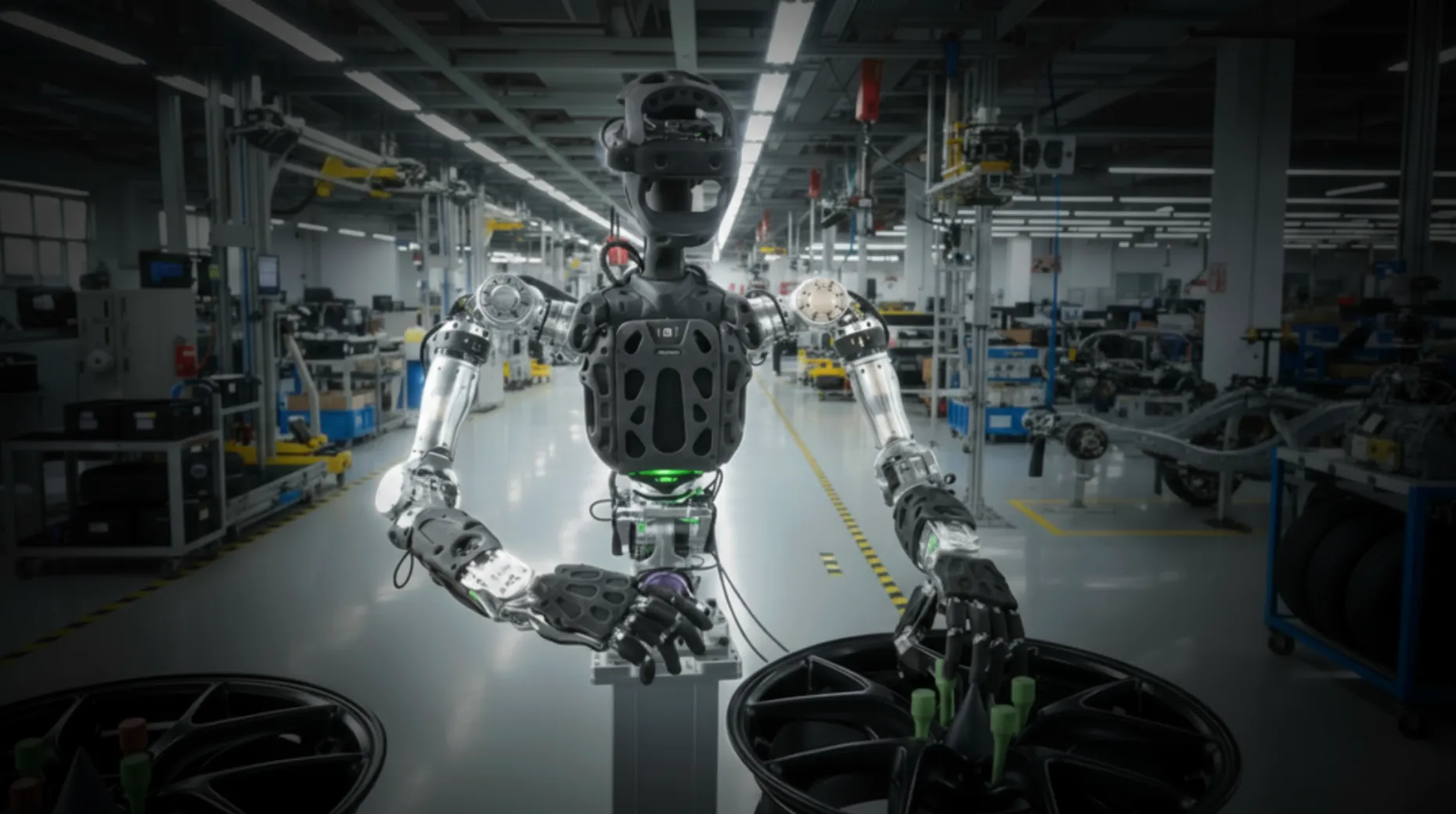

Being-H0物理指令微调框架

研究团队借鉴视觉指令微调的成功思路,设计了一套完整的物理指令微调框架,专门针对2D视觉语言数据与3D动作空间之间的异构性问题进行优化。该框架包含三个关键组成部分:

预训练阶段:从百万级人手视频中学习:

传统多模态模型在迁移至具身任务时,常因数据模态差异而受限。为此,团队构建了统一的多模态自回归架构,通过海量手部轨迹数据融合视觉、语言与动作表征。在编码设计上,针对手腕和手指分别采用专用编码器,并基于分组的残差变分量化自编码器进行动作离散化,将姿态重建误差控制在毫米级。

物理空间对齐:实现2D视频到3D空间的映射:

通过统一的坐标系转换方法,消除不同视频来源在相机参数、观测视角等方面的差异,确保模型学习的空间与动作表征具备一致性和可迁移性。

后训练阶段:从预训练模型迁移至真实机器人

建立从人类动作到机器人操作的高效转换机制,确保技能迁移的准确性和泛化能力。

亿级规模UniHand数据集

为支撑物理指令调优框架的训练,研究团队建立了一套完整的数据采集与处理流程,整合了来自11个开源数据源的多模态信息,涵盖动作捕捉、虚拟现实设备及常规RGB视频等多种来源。最终构建的UniHand数据集包含1.5亿条人类手部动作指令样本,涵盖手势生成、动作语义理解、上下文感知动作预测等任务。

UniHand数据集

值得注意的是,即使仅使用其中250万条样本进行训练,模型在多项评估中已显示出明显优势。

真机实验验证

除了常规任务评估,研究团队还开展了系统的真实机器人实验。实验结果显示,在相同下游任务训练条件下,基于物理指令调优的Being-H0模型明显优于基座模型InternVL3,也超越了同期英伟达开源的VLA模型GR00T N1.5。

需要特别指出的是,尽管GR00T N1.5在训练中使用了更大规模的人类视频数据,但Being-H0凭借其高度结构化的数据构建策略,在动作学习效率与任务成功率方面表现更佳。

这一对比结果有力地证实了本研究数据构建策略的有效性:通过显式构建与下游任务结构高度对齐的预训练数据,能够显著提升模型从视频数据中学习人类动作知识的效果,进而提高下游任务的成功率。

为深入验证方法的鲁棒性,研究团队进一步对比了Being-H0与未经预训练的基础模型在不同训练数据规模下的性能表现。实验设置了从25%到100%不等的训练数据采样比例,结果表明在相同数据量条件下,Being-H0模型始终展现出稳定的性能优势。

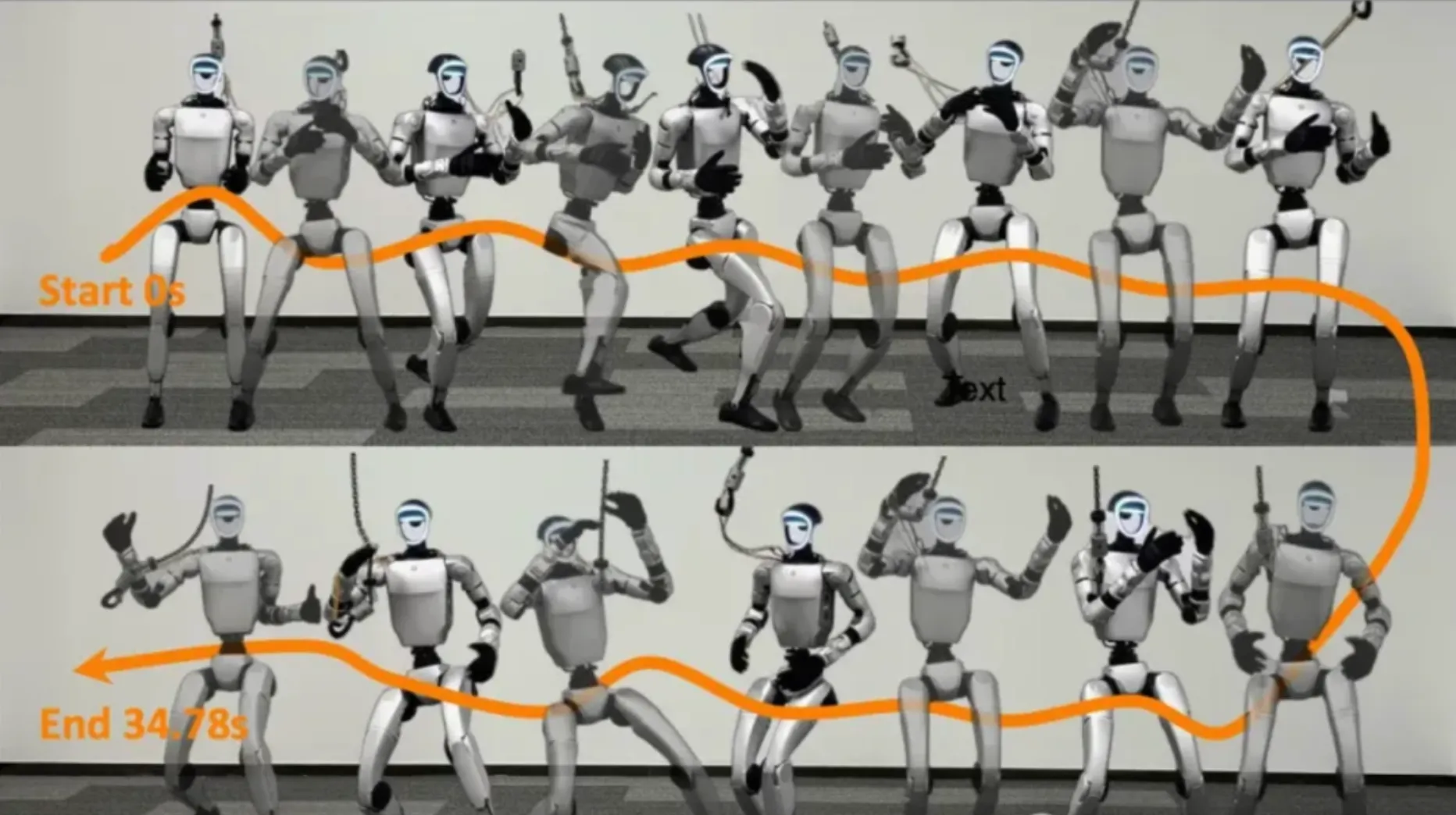

Pick-Place-Toy任务

此外,在同样成功率下,Being-H0所需要的真机数据量远少于其他模型(例如,在Pick-Place-Toy任务中,该模型仅用25%的真实数据就能达到其他模型使用全部数据时的相近成功率,显著提升了数据利用效率。)。

这一系列实验不仅验证了物理指令调优框架的有效性,同时也证实了该方法可以显著降低真机数据量。

文章链接:https://arxiv.org/pdf/2507.15597

项目官网:https://beingbeyond.github.io/Being-H0/

关于BeingBeyond智在无界:

BeingBeyond开创了利用大规模人类数据训练通用具身模型的范式,灵巧手操作模型(Being-H系列)以及人形机器人移动操作模型(Being-M系列)均具备行业领先性能,且可以跨本体部署。同时,团队构建的全球最大第一视角手部数据集和全身姿态数据集,正在成为驱动模型迭代的核心基础。BeingBeyond专注通用人形机器人模型研发,为机器人本体厂商及落地场景客户提供强泛化、可落地的具身模型。