BeingBeyond新突破:BumbleBee-通用人形机器人全身控制范式,

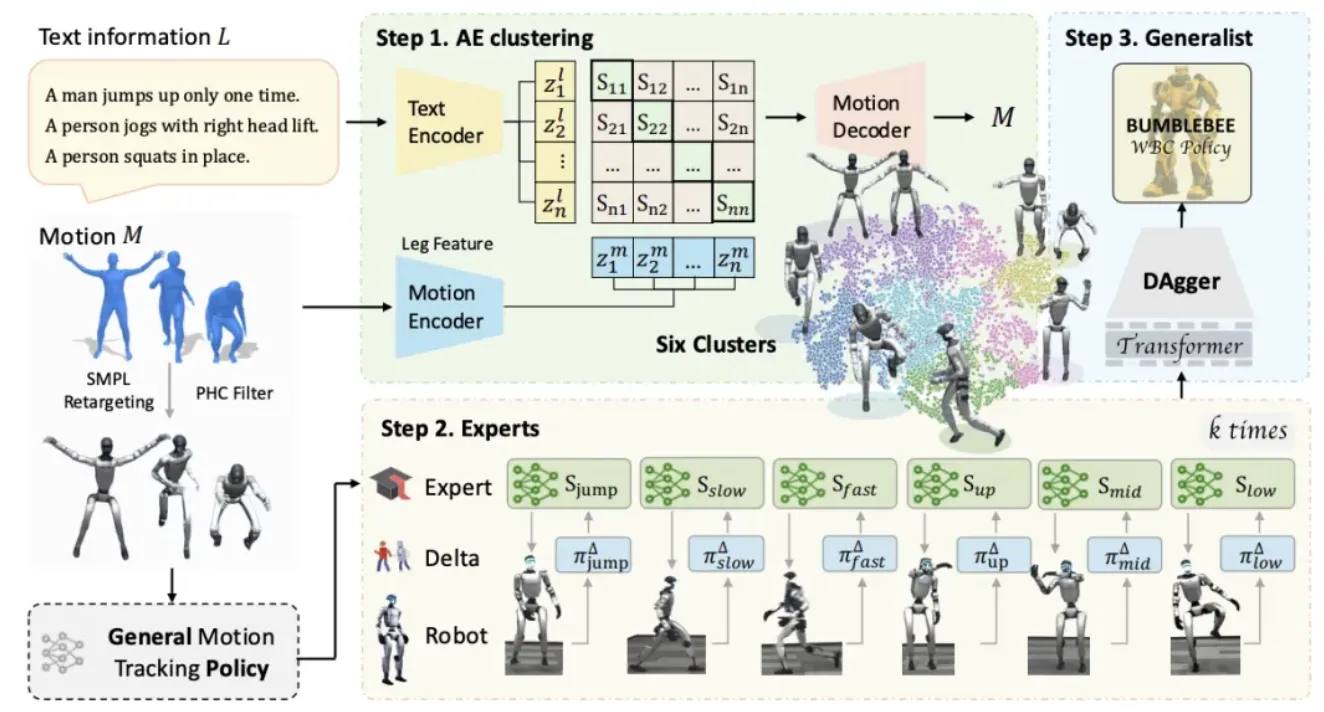

近日,智在无界BumbleBee团队提出了一条完整的“基础—聚类—迭代—蒸馏”人形机器人全身控制训练流程。兼顾了人形机器人动作多样性和现实适应性,为通用敏捷的人形机器人控制提供了一种新的训练范式。

该研究首先利用 AMASS 数据集训练基础的全身控制模型;在此基础上,通过聚类区分不同类型的动作,并分别训练相应的专家控制模型;随后,将这些专家模型部署到真实机器人上,采集执行轨迹;基于采集的轨迹序列,为每个专家模型训练对应的动作增量模型(delta model),以缓解仿真与现实之间的差距(sim-to-real gap);最后,利用知识蒸馏将经过微调的专家模型融合为一个更为稳健且具备泛化能力的通用控制模型。

论文创新点

专家—通才训练范式:区别于直接训练单一通用策略的方法,BumbleBee 先通过动作语义与动力学特征进行聚类,分别训练专家控制策略,再将专家知识蒸馏为通用策略,从而有效缓解跨任务间的冲突。

多模态自监督聚类:结合动作自编码器与文本语义对齐,同时引入足端接触与速度等显式腿部特征,使得如“跳跃、慢走、原地上肢动作”等不同动作类型能够在隐空间中区分。

分簇的仿真-现实补偿:在 ASAP 框架的基础上扩展动作增量方法,为每个动作簇单独训练增量模型,相较于统一的通用增量模型更能有效消除类别差异带来的仿真-现实偏差。

AE 聚类 —— 对经过 PHC 筛选的 AMASS 高质量动作轨迹(共 8179 段)进行处理。采用Transformer对动作序列进行编码,将 SMPL 关节轴角与根坐标转换为三维关节点位置,并删除冗余节点。同时,引入腿部相对速度和地面接触信号以增强动力学表征。并行地,利用 BERT 对 HumanML3D 数据集中的文本描述进行编码,实现动作与文本表征的对齐。最终,根据动作编码在表征空间中完成聚类。

专家学习 —— 首先在全数据上训练一个基础控制策略,作为专家模型的初始点。随后,针对聚类结果在各动作簇上分别微调,得到更具针对性的专家模型。接着,将专家模型部署到真实机器人上执行以采集轨迹,并基于这些轨迹为每个类别单独训练动作增量模型,再冻结增量模型对专家进行微调,实现对仿真与现实间偏差的补偿。通过迭代更新,专家模型在“更优策略—更高质量数据—更精准增量—再优化专家”的循环中逐步提升性能。

通才蒸馏 —— 在专家模型与动作增量模型收敛后,进入融合阶段。基于 DAgger 框架,同时蒸馏多个类别的专家模型,并在训练时调整数据分布以保持类别间的平衡,避免偏置。在模型结构上,采用 Transformer 作为通用控制器的骨干网络以增强时序建模能力。最终得到的通用策略在敏捷性与稳健性之间实现了较优平衡,并展现出优于单个专家模型或直接训练得到的通用模型的表现。

实验验证

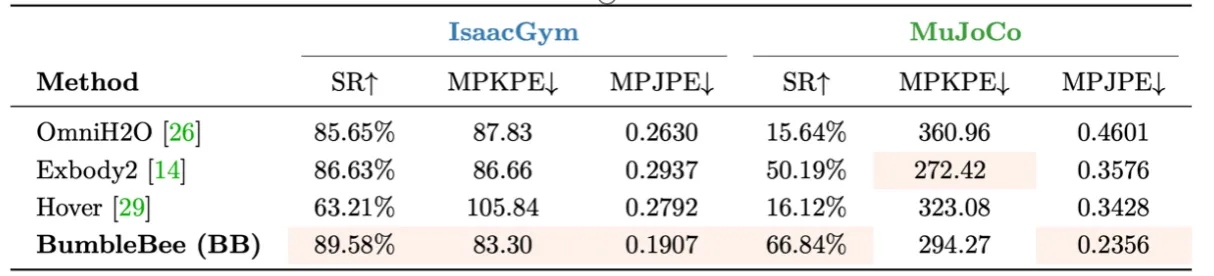

1.与基线对比:

在更贴近真实动力学的 MuJoCo 平台上,BumbleBee 的成功率达到 66.84%,显著高于 Exbody2(50.19%),同时其他基线均低于 40%。在 IsaacGym 上,BumbleBee 在成功率、MPJPE 和 MPKPE 三个指标上也全面优于对比方法。

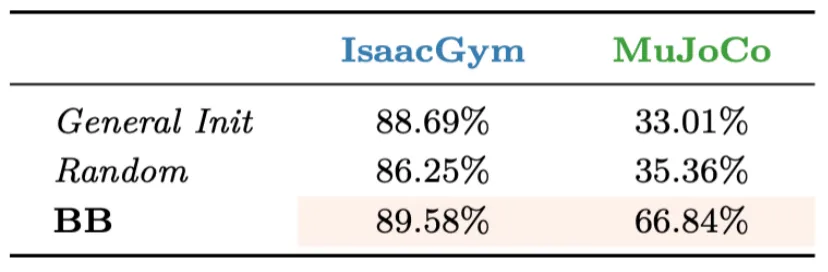

2.聚类与专家作用分析

无专家直训(General Init)、随机分簇专家(Random)与 BumbleBee 的对比结果显示,在 MuJoCo 上三者成功率依次为 33.01%、35.36% 和 66.84%。结果表明合理的聚类与专家学习显著优于随机切分或直接训练通用模型。

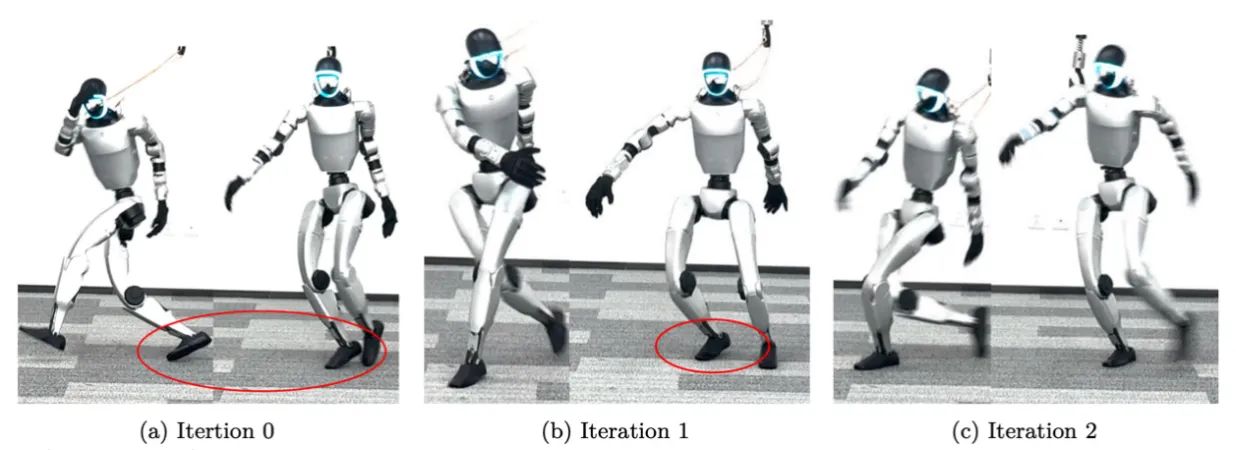

3.真实机器人实验

Iter 0(未经过动作增量模型微调):机器人无法保持稳定,落地失败并导致系统崩溃。

Iter 1:稳定性明显改善,但仍存在抬脚困难与身体抖动。

Iter 2:机器人能够平滑跟踪参考动作并维持整体平衡。

关于BeingBeyond智在无界:

BeingBeyond开创了利用大规模人类数据训练通用具身模型的范式,灵巧手操作模型(Being-H系列)以及人形机器人移动操作模型(Being-M系列)均具备行业领先性能,且可以跨本体部署。同时,团队构建的全球最大第一视角手部数据集和全身姿态数据集,正在成为驱动模型迭代的核心基础。BeingBeyond专注通用人形机器人模型研发,为机器人本体厂商及落地场景客户提供强泛化、可落地的具身模型。