Being-VL-0.5: 通过视觉BPE编码实现更统一的多模态理解

近日,BeingBeyond与北京大学共同推出业界首个将字节对编码(BPE)机制系统性引入视觉模态的多模态大模型Being-VL-0.5。

该模型通过百万级量化视觉数据训练,验证了结构化先验注入在跨模态对齐中的技术可行性,为统一离散表示框架下的多模态理解与生成奠定了理论基础。

作为视觉-语言领域的技术突破,Being-VL-0.5在标准基准测试中展现了与连续嵌入方法相当的性能,同时显著降低了对训练数据量的依赖。其课程驱动的训练策略与渐进式参数解冻机制,有效解决了视觉token高层语义缺失的难题,推动了多模态模型从局部特征提取向全局语义理解的跨越。

论文封面

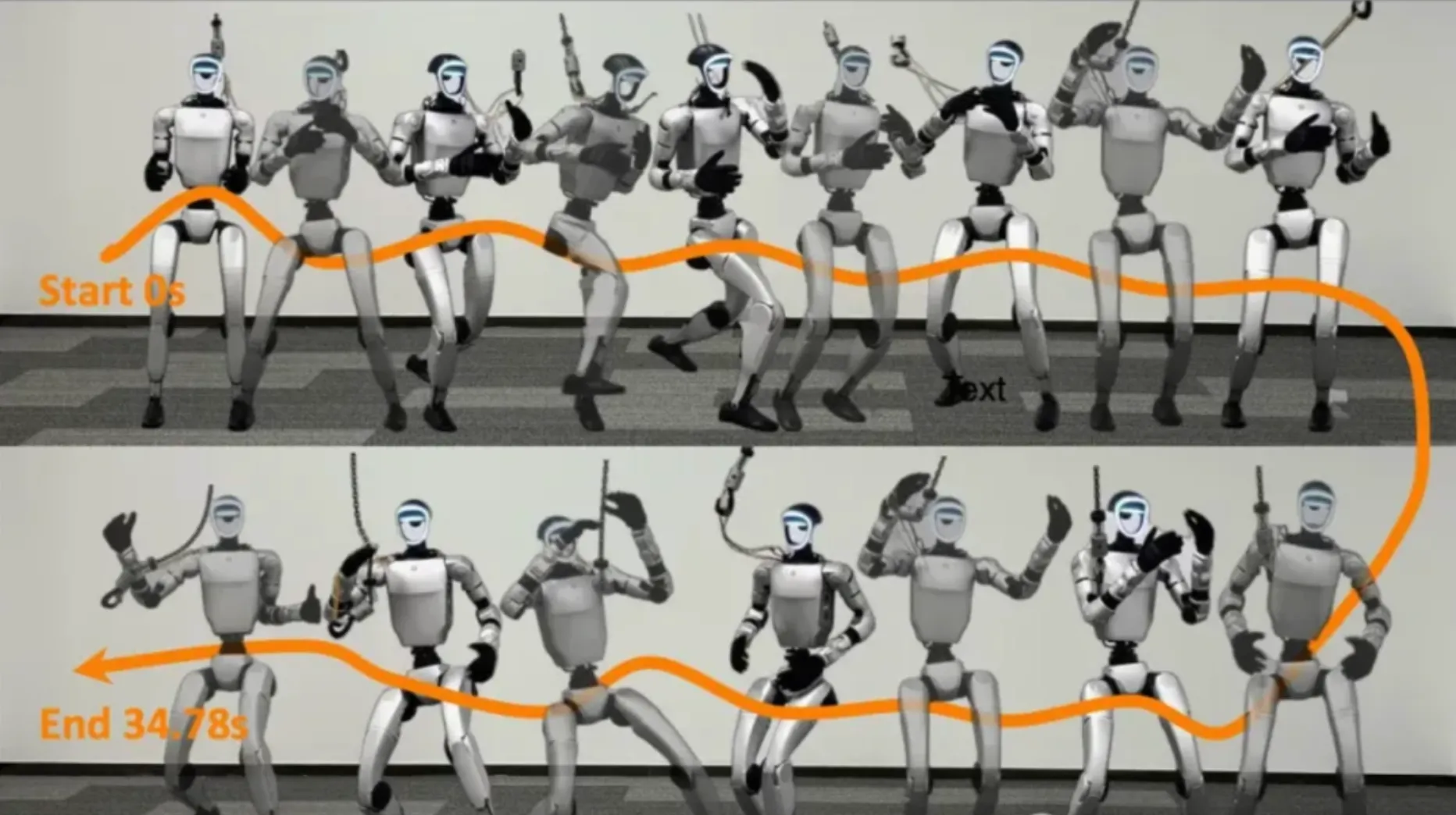

BeingBeyond将持续深化统一模态表示的研究,探索音频、3D点云等更多模态的BPE编码扩展,并致力于构建面向具身智能的通用多模态生成框架,最终实现人形机器人自主性与通用能力的突破性提升。

论文已被 ICCV 2025 接收。

核心理论创新

传统多模态模型在处理视觉信息时往往弱于文本,视觉表示缺乏高层语义结构。BeingBeyond与北京大学的研究团队在ICLR 2025前期工作《From Pixels to Tokens: Byte-Pair Encoding on Quantized Visual Modalities》的理论发现——Transformer模型在原始序列学习中的Unigram统计局限性可通过结构化tokenization突破。

基于这一结论,研究团队在本研究中进一步验证:"Tokenization不仅是数据压缩手段,更是向模型注入结构化先验的关键机制。"

核心技术架构

1.统一的离散表示基础:

采用VQ-GAN将视觉图像量化为离散token序列,但我们发现初始token仅含局部视觉信息,缺乏高层语义结构。

2.优先级引导的视觉BPE编码:

共现频率:统计空间邻接VQ token在数据中的出现频率,构建层级视觉词汇表

空间一致性:评估token对在不同图像中保持稳定空间关系的程度

3.课程驱动的数据组合策略,基于层次化视觉模式(从简到复杂),我们团队设计了一个四阶段学习课程:

基础阶段:建立基本视觉-语言对齐

感知阶段:学习详细视觉属性

推理阶段:发展复杂视觉推理能力

指令阶段:优化任务执行能力

4.渐进式参数解冻训练,采用三阶段策略确保视觉表示与语言模型的有效融合:

第一阶段:仅训练扩展的视觉token嵌入

第二阶段:选择性解冻早期Transformer层

第三阶段:全参数微调

实验验证

实验结果有力地验证了研究团队的理论预测。在多个标准基准测试上的结果显示,Being-VL-0.5实现了与主流连续嵌入方法相当的性能,同时保持了统一token表示的优势。

特别值得注意的是,研究团队在训练数据量远低于传统CLIP编码器的情况下,仍然取得了可观的性能,展现了该方法的高效性。

此外,通过可视化分析,研究团队观察到使用BPE的模型在token激活模式上展现出更合理的分布,验证了论文关于结构化先验注入的理论假设。

本研究首次系统性地将BPE的结构化先验注入机制应用于视觉模态,设计了匹配视觉BPE特性的完整训练流程,其更深层次的意义在于为统一离散表示的多模态理解与生成提供了理论基础。

研究团队表示,未来工作将探索更多模态(如音频、3D点云)的统一表示可能性,推动多模态生成任务的发展。

论文全文:https://arxiv.org/abs/2506.23639

项目主页:https://beingbeyond.github.io/Being-VL-0.5

关于BeingBeyond智在无界:

BeingBeyond开创了利用大规模人类数据训练通用具身模型的范式,灵巧手操作模型(Being-H系列)以及人形机器人移动操作模型(Being-M系列)均具备行业领先性能,且可以跨本体部署。同时,团队构建的全球最大第一视角手部数据集和全身姿态数据集,正在成为驱动模型迭代的核心基础。BeingBeyond专注通用人形机器人模型研发,为机器人本体厂商及落地场景客户提供强泛化、可落地的具身模型。