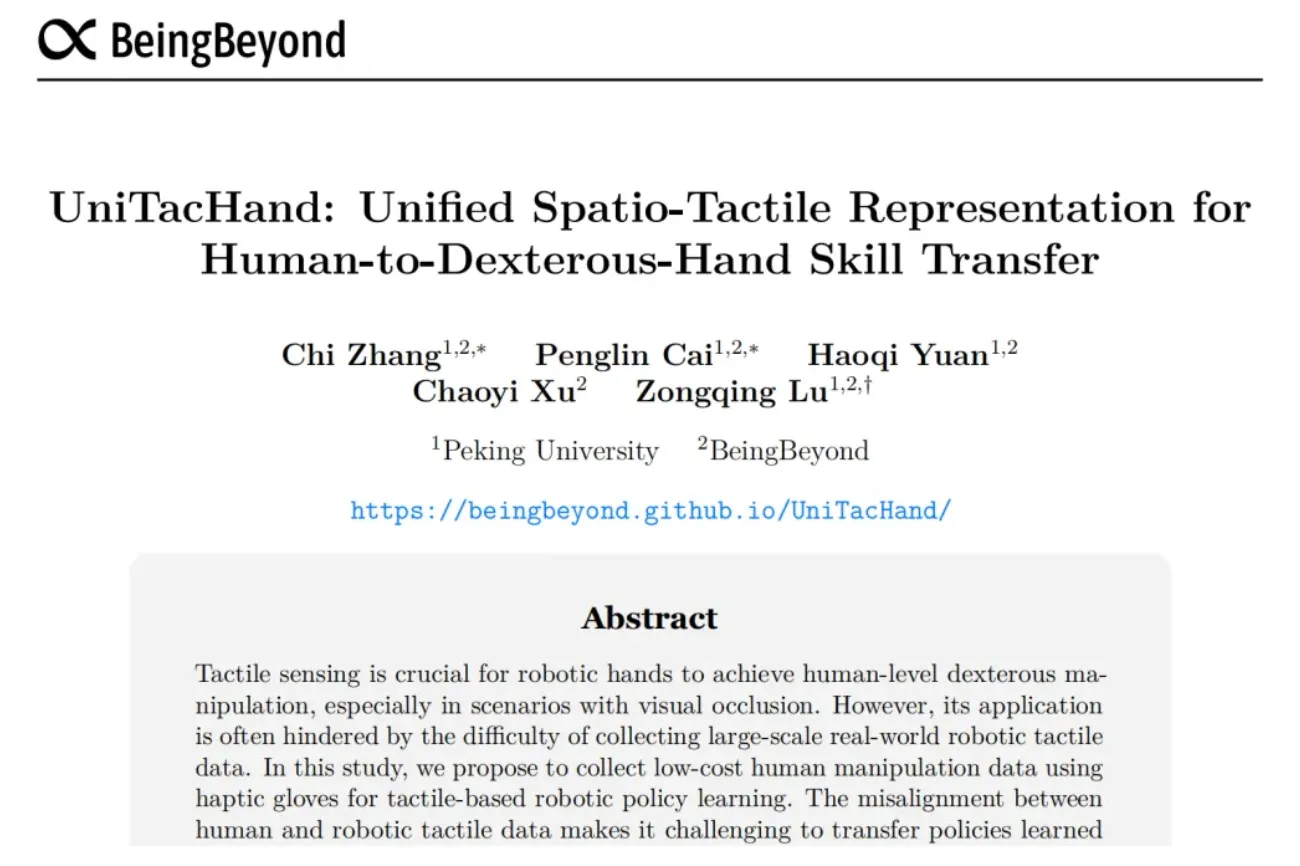

BeingBeyond最新成果:首次实现人手-机器人触觉数据迁移,直击行业痛点

近日,BeingBeyond团队提出人手-机器人触觉数据迁移创新性解决方案——UniTacHand,通过“形态统一+特征对齐”的双阶段框架,仅需10分钟人机配对数据,就能搭建人类触觉与灵巧手触觉之间的桥梁,实现零样本技能迁移。

这项研究不仅突破了触觉数据收集的高成本瓶颈,更首次验证了“人类触觉数据+少量机器人样本”的高效训练范式,为灵巧手触觉操作开辟了通用、可扩展的新路径。

UniTacHand核心突破:用“统一表征”破解人类触觉和灵巧手触觉之间的鸿沟

在视觉遮挡、接触密集的复杂场景中,触觉感知是机器人实现人类级灵巧操作的核心。但高质量机器人触觉数据的稀缺性、人机手部形态与传感器的异质性,正成为触觉领域从人类数据学习到真机策略迁移道路上的两大难题。

目前行业主流的解决方案有以下几类:

要么是依赖海量真机数据,这种方案对数据数量和质量要求极高;要么是在仿真中通过强化学习等方式训练策略再进行真机部署,但是该方案会花费巨大的时间成本,而且还有sim-to-real gap(仿真到真实的差距)的限制;要么受制于具身差距,由于人类数据和真机之间的本体差异和鸿沟,难以直接迁移到现实世界的机器人。即便少数尝试触觉迁移的方法,也仅适用于简单夹爪,无法适配高自由度灵巧手。

UniTacHand论文封面

BeingBeyond与北京大学团队的UniTacHand方案则是基于一个关键洞察:人类手部与机器人灵巧手的操作逻辑本质相通,只需找到一种能抹平形态差异、保留触觉实际物理含义的的通用表示,就能实现技能的直接迁移。

基于此,团队创新性地将MANO手部模型的2D UV映射作为统一表征载体,结合对比学习框架,有效解决了“形态异构”与“特征错位”两大核心问题,实现从人手到灵巧手的触觉策略的零样本迁移。

1. 形态统一——MANO UV映射抹平人机差异

不同的触觉传感器布局不同、不同品牌的灵巧手硬件结构不同,导致了触觉信息存在很大的本体差异。UniTacHand通过MANO手模型经标准化2D得到的UV Map空间,将两类异质数据归结为统一格式:

- 人类触觉数据:手动标注传感器区域与MANO模型表面顶点的对应关系,通过双线性插值将稀疏压力信号扩散为891维信息的UV图,保留了触觉信息的空间特征;

- 机器人触觉数据:先通过优化方法找到与机器人手形态最匹配的MANO参数,再通过实时姿态重定向,将机器人关节状态映射为MANO姿态,最终通过加权插值生成统一UV图;

- 后处理优化:加入高斯平滑与有效信息掩码,确保触觉信号更加合理并减少冗余信息。

这种处理方式不仅让从空间上缓解了异质性问题,更天然嵌入了接触位置和正压力强度的空间信息,为后续迁移奠定基础。

2. 特征对齐——对比学习构建人机共享的隐空间

仅形态统一不足以消除数据分布差异——人手和机械手在进行相同的物体操作类任务时,手部姿态并不一定相同(如人手抓握物体时习惯将整个物体贴合于手掌,而Inspire等灵巧手则经常通过手指部分捏起物体),导致触觉激活的区域也会不同。UniTacHand设计了针对性的对比学习框架,使得人手、灵巧手的触觉特征在隐空间中共享一套相同的表示。

在表示学习部分,团队提出使用双编码器架构:人手触觉与灵巧手触觉数据分别通过“触觉输入编码器 + 手部姿态编码器”的双编码路径,确保触觉与动作信息的协同表征。通过对比对齐损失(InfoNCE)、重建损失(MSE)、域对抗损失(BCE)三重损失函数,学习出一个人手、灵巧手的触觉特征共享的通用隐空间表示。

MANO手部模型2D UV映射

10分钟配对数据能达到零样本迁

传统迁移方法需要百万级人类或机器人样本进行大规模预训练,而后在特定任务上进行微调才能收敛,而UniTacHand的核心优势在于“数据高效”——仅需10分钟(16k帧,40Hz)的人机配对数据训练对齐模型,再结合低成本获取的人类触觉数据,就能实现高效迁移。

团队构建的配对数据集涵盖50类日常物体(水果、饮料瓶、玩具等),包含688条操作轨迹,覆盖抓握、按压、移动等多种接触场景。值得注意的是,即便是这样小规模的配对数据,经过物理启发的增强后,也能支撑模型学习到稳健的跨域映射。更关键的是,人类触觉数据的收集成本远低于机器人——仅需普通压力敏感手套+运动捕捉设备,就能大规模采集,彻底摆脱对昂贵真机数据的依赖。

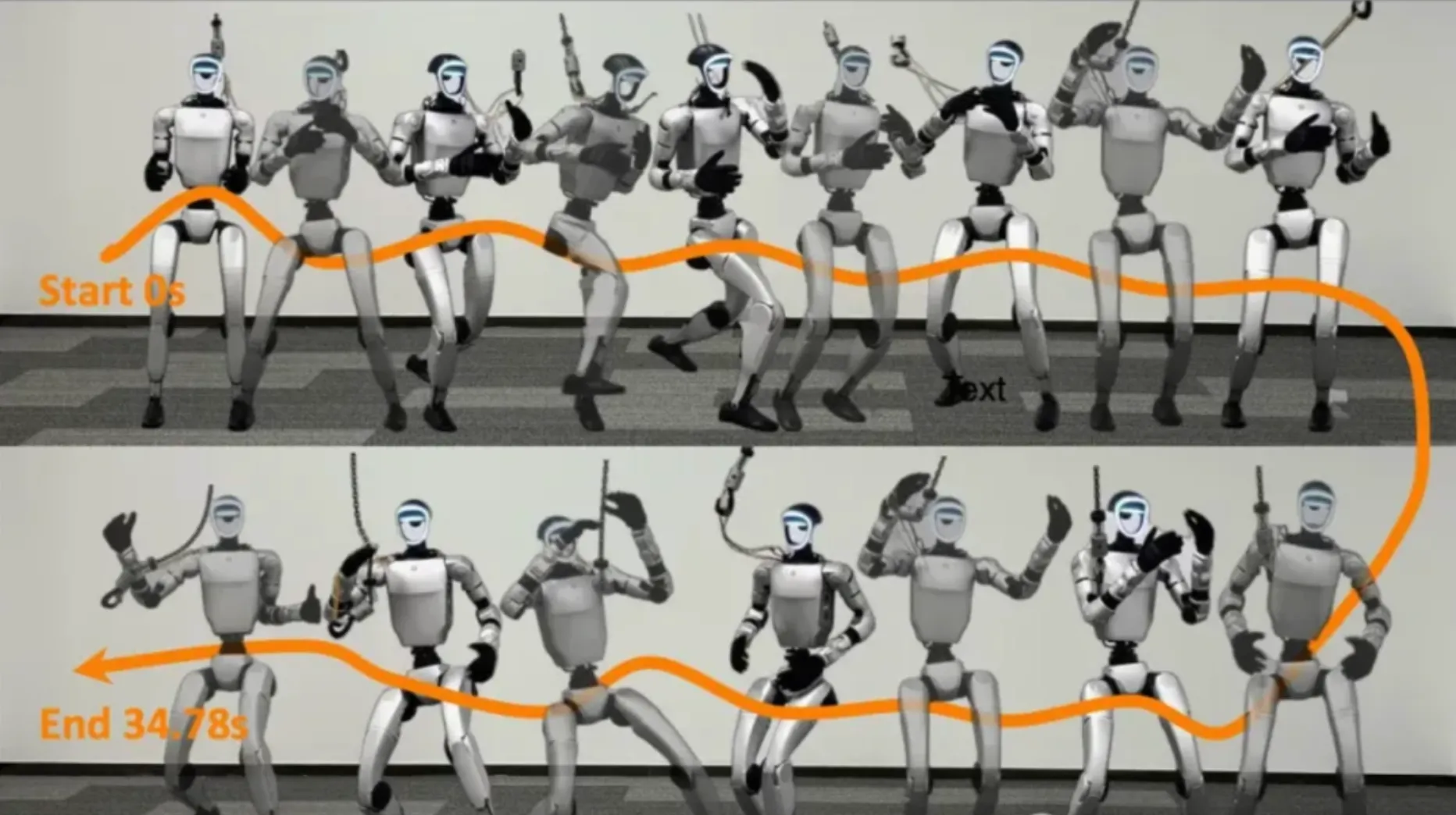

UniTacHand实验效果

真机实验:纯人类数据实现灵巧手触觉技能迁移,混合数据超越纯真机数据

为验证方法有效性,团队在Inspire 6DoF灵巧手+RealMan 6DoF机械臂平台上,开展了5类核心任务测试,结果全面超越传统基线:

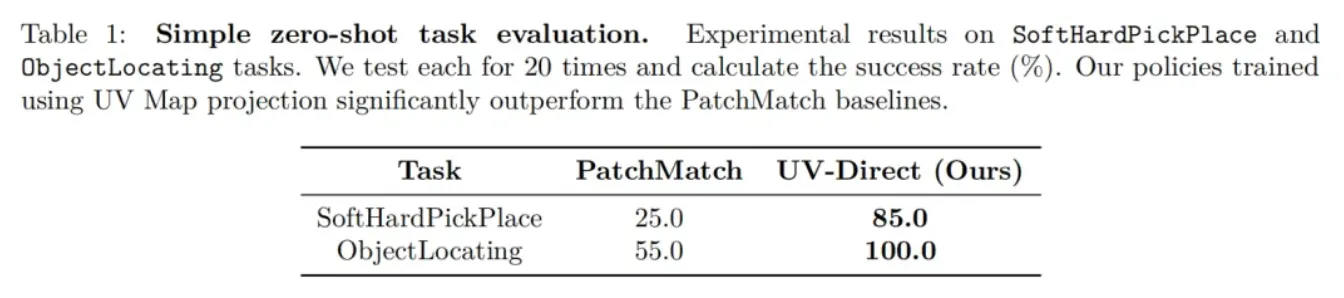

1. 统一UV Map用于零样本迁移:无需机器人数据,直接部署即生效

- ObjectLocating(物体定位):机器人通过触觉判断物体位置并调整机械臂末端位置再进行抓取,UniTacHand成功率100%(基线PatchMatch仅55%);

- SoftHardPickPlace(软硬分类放置):通过触觉区分物体软硬并放入对应篮子,UniTacHand成功率85.0%(PatchMatch基线仅25%)。

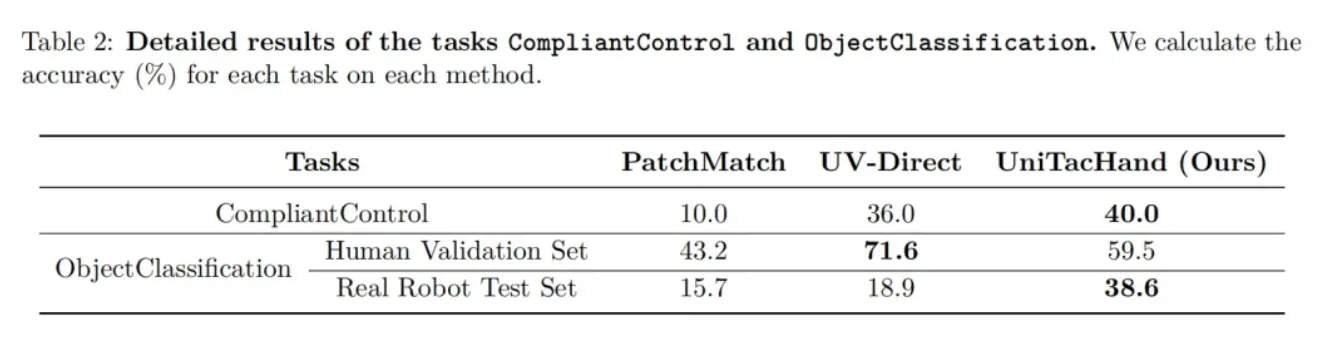

2. 少量配对数据学得表示用于零样本迁移

- CompliantControl(柔顺控制):在灵巧手手掌上通过施加推拉力的方向,使得机械臂末端跟随施力人的方向进行运动,UniTacHand运动方向准确率40%(远超PathMatch的10.0%);

- ObjectClassification(物体分类):对10类未见物体(含不同形状、材质)分类,机器人测试集准确率38.6%(远超UV-Direct的18.9%)。

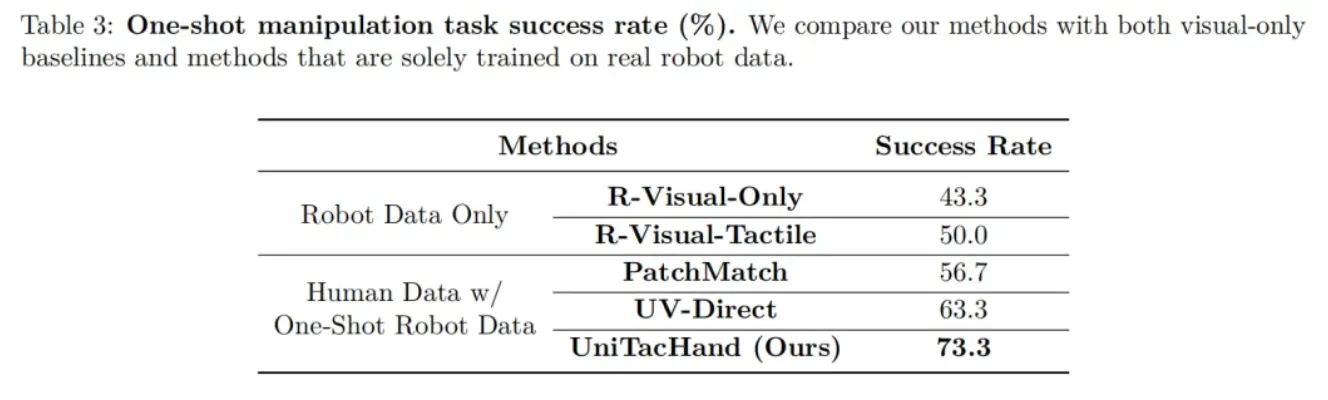

3. 单样本混合训练:人类数据+单条真机数据,性能翻倍

在“视觉易混淆、触觉辨差异”的任务中(如空瓶/装满水的瓶子),UniTacHand结合人类数据+单条真机数据训练,成功率达73.3%,远超纯机器人数据训练的方法(R-Visual-Only:43.3%;R-Visual-Tactile:50.0%),且比使用人类数据+单条真机数据的PatchMatch、UV-Direct等baseline提升10到20个百分点。

作为首个实现零样本人手-灵巧手触觉技能迁移的统一表征框架,该研究不仅解决了触觉迁移的核心瓶颈,更构建了“人类数据→统一表征→机器人技能”的高效路径。

团队表示,未来将进一步扩大人类触觉数据收集规模,探索将触觉模态融入视觉-语言-动作(VLA)基础模型,推动机器人从“视觉主导”向“多模态协同”进化,让灵巧操作真正走进日常生活。

关于BeingBeyond智在无界:

BeingBeyond开创了利用大规模人类数据训练通用具身模型的范式,灵巧手操作模型(Being-H系列)以及人形机器人移动操作模型(Being-M系列)均具备行业领先性能,且可以跨本体部署。同时,团队构建的全球最大第一视角手部数据集和全身姿态数据集,正在成为驱动模型迭代的核心基础。BeingBeyond专注通用人形机器人模型研发,为机器人本体厂商及落地场景客户提供强泛化、可落地的具身模型。